Cada vez que tuve que importar un CSV a la tabla de la base de datos, siempre escribí mi propio analizador/importador de csv. Es bastante simple.

Aquí hay un ejemplo.

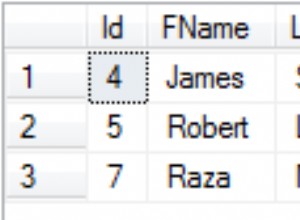

prueba.csv

Firstname,Lastname,Age

"Latheesan","Kanes",26

"Adam","Smith",30

prueba.php

<?php

// Mini Config

$csv_file = 'test.csv';

$delimiter = ',';

$enclosure = '"';

$skip_first_row = true;

$import_chunk = 250;

// Parse CSV & Build Import Query

$import_queries = array();

$first_row_skipped = false;

if (($handle = fopen($csv_file, "r")) !== FALSE) {

while (($data = fgetcsv($handle, 1000, $delimiter, )) !== FALSE) {

if ($skip_first_row && !$first_row_skipped) {

$first_row_skipped = true;

continue;

}

list($firstname, $lastname, $age) = $data;

$import_queries[] = "INSERT INTO myTable (firstname, lastname, age) VALUES ('$firstname', '$lastname', $age);";

}

fclose($handle);

}

// Proceed if any data got parsed

if (sizeof($import_queries))

{

foreach(array_chunk($import_queries, $import_chunk) as $queries)

{

$dbh->query(implode(' ', $queries));

}

}

?>

Las consultas analizadas se verán así (si print_r es):

Array

(

[0] => INSERT INTO myTable (firstname, lastname, age) VALUES ('Latheesan', 'Kanes', 26);

[1] => INSERT INTO myTable (firstname, lastname, age) VALUES ('Adam', 'Smith', 30);

)

Tiene dos opciones para la importación real a la base de datos:

-

Cree una colección de consultas sql de importación y ejecútela en un lote (array_chunk); esto significa menos consultas en su base de datos. Sin embargo, como puede ver, no estoy comprobando los valores del CSV, es decir, confío en mi fuente de datos y no se me escapa nada, es un poco peligroso...

-

Ejecuta la consulta, tan pronto como la haya creado escapando de los valores; el pequeño inconveniente es que ejecutará una consulta por fila en csv....

Espero que esto ayude.